02 : Cognition, Schémas & Temps de réaction

Dans cet épisode, nous explorons la question de la réaction en quasi temps réel face à une quantité importante d'informations. Nous découvrons que le cerveau traite les données de l'environnement de manière rapide et efficace en utilisant des schémas cognitifs.

« Comment traiter autant d'informations et prendre des décisions en quasi-temps réel ? ». C'est avec cette question que nous avons clôturé l'épisode précédent, et c'est ce que nous devons continuer à explorer dans celui-ci.

Reformulé différemment, quasi temps réel voudrait dire un tout petit délai entre la perception et l'action. L'exemple du lion nous a permis de comprendre qu'il serait compliqué de traiter consciemment chaque stimulus. Cette mécanique prendrait beaucoup trop de temps et affecterait dangereusement notre capacité à réagir à toutes les menaces potentielles. Donc, pour avoir cette indispensable promotion sur notre temps de réaction, le cerveau doit traiter les données de l'environnement dans des délais très courts, et pour faire les choses rapidement et bien, il n'y a pas non plus 36000 solutions.

La première hypothèse serait d'allouer beaucoup de ressources au traitement de l'information, en d'autres termes, on booste la partie « machine » pour traiter plus de données. Pour informations sur ce sujet...

- Le cerveau, c'est 500 milliards de cellules (dont 89 milliards de neurones et le reste en cellules gliales dont nous aborderons sûrement plus tard car c'est quand même super important). Toutes ces cellules sont dédiées à notre cognition. Pour comparaison, la plus petite des dernières puces Apple Silicone, la M3, l'une des puces grand public les plus puissantes, possède 25 milliards de transistors sur son "Neural Engine", la partie "cerveau" du processeur, celle dédiée à faire tourner les différentes intelligences artificielles utilisées par la machine. On a encore un petit peu d'avance sur les machines, ne vous en faites pas... En tout cas pour le moment.

- C'est une consommation d'énergie qui avoisine environ 3 Watts. En plus de ce chiffre, gardez en tête que notre activité cognitive consomme environ 25% de nos besoins caloriques journaliers.

- La taille du cerveau est de 1350 m3 en moyenne, ce qui est petit pour un truc aussi puissant, mais qui est surtout stable depuis environ 300 000 ans. Entre l'homme de Néandertal et Homo sapiens, il y a même eu une réduction de la taille du cerveau passant de 1500 m3 à cette taille actuelle.

Le croisement irréaliste de ces quelques chiffres confère à notre système nerveux la médaille de la machine la plus complexe connue. C'est une forme de "data crusher" super puissant qui est à l'origine de nos super pouvoirs. Ces ressources sont certes extraordinaires, mais entre la perception des stimuli externes, la perception de ceux internes, l'émergence d’idées, la gestion des émotions, la coordination motrice et les milliards d'autres choses à faire en même temps, il est difficile de vraiment quantifier le nombre de données et d'informations traitées, mais on pourrait imaginer qu'une milliseconde de vie active demande ces extraordinaires ressources. Croisé avec le fait que le cerveau n'a pas évolué depuis un bout de temps, nous pouvons partir du principe qu'il semblerait que nous ayons atteint une forme d'équilibre, ou plutôt de déséquilibre maîtrisé.

Mais la ressource disponible n'explique qu'une partie des choses. C'est un peu comme dire que pour aller d'un point A à un point Z en 30 secondes, il faudrait une machine qui se déplace à 500 km/h. Nous avons clairement la machine qui permet de produire ces performances, mais cela ne nous dit pas comment elle y arrive et surtout comment elle fait pour ne pas exploser.

Si nous mettons de côté la partie matériel, alors la question serait plus sur l'applicabilité et la gestion de ces ressources, en d'autres termes une sorte de partie "logiciel". Globalement, en organisation, si vous voulez gagner du temps dans la réalisation de différentes tâches, vous avez deux grands corps de stratégie : la mutualisation et l'automatisation. Nous verrons que les deux vont de pair, mais pour le moment concentrons-nous sur le premier qui pour moi, en tout cas pour moi en 2009, fut le plus important.

Une théorie de la mutualisation cognitive voudrait dire que l'on partagerait des ressources et des processus mentaux entre différentes tâches. Cette approche dirait que, au lieu de développer des systèmes hyper-spécifiques à une tâche consommatrice de ressources, on aurait développé des systèmes polyvalents généralistes qui s'adapteraient à une quantité indéfinie de tâches. Cela voudrait dire que pour pouvoir traiter autant de complexité rapidement et avoir nos temps de réaction réduits, notre système d'exploitation mental devrait être généraliste. Cela nous fait poser des questions sur le rôle des profils généralistes en entreprise, non ? #jecriraisuneversionsurlesressourceshumainesplustard

Il est toujours intéressant de noter que chacune de nos habitudes peut être source d'inspiration et de réflexion lorsqu'on prend un regard extérieur. Pour moi, ce fut mon obsession pour les schémas. Peu habile avec les mots, je me suis retrouvé à synthétiser mes pensées dans de moches formes géométriques connectées entre elles. Au-delà des formes, de leur sens et de mon utilisation, les schémas procurent un outil pour visualiser des relations entre des concepts transposables à différents univers. Je vais m'expliquer, mais en gros, l'idée était d’imaginer un fonctionnement du cerveau basé sur ce concept de schéma.

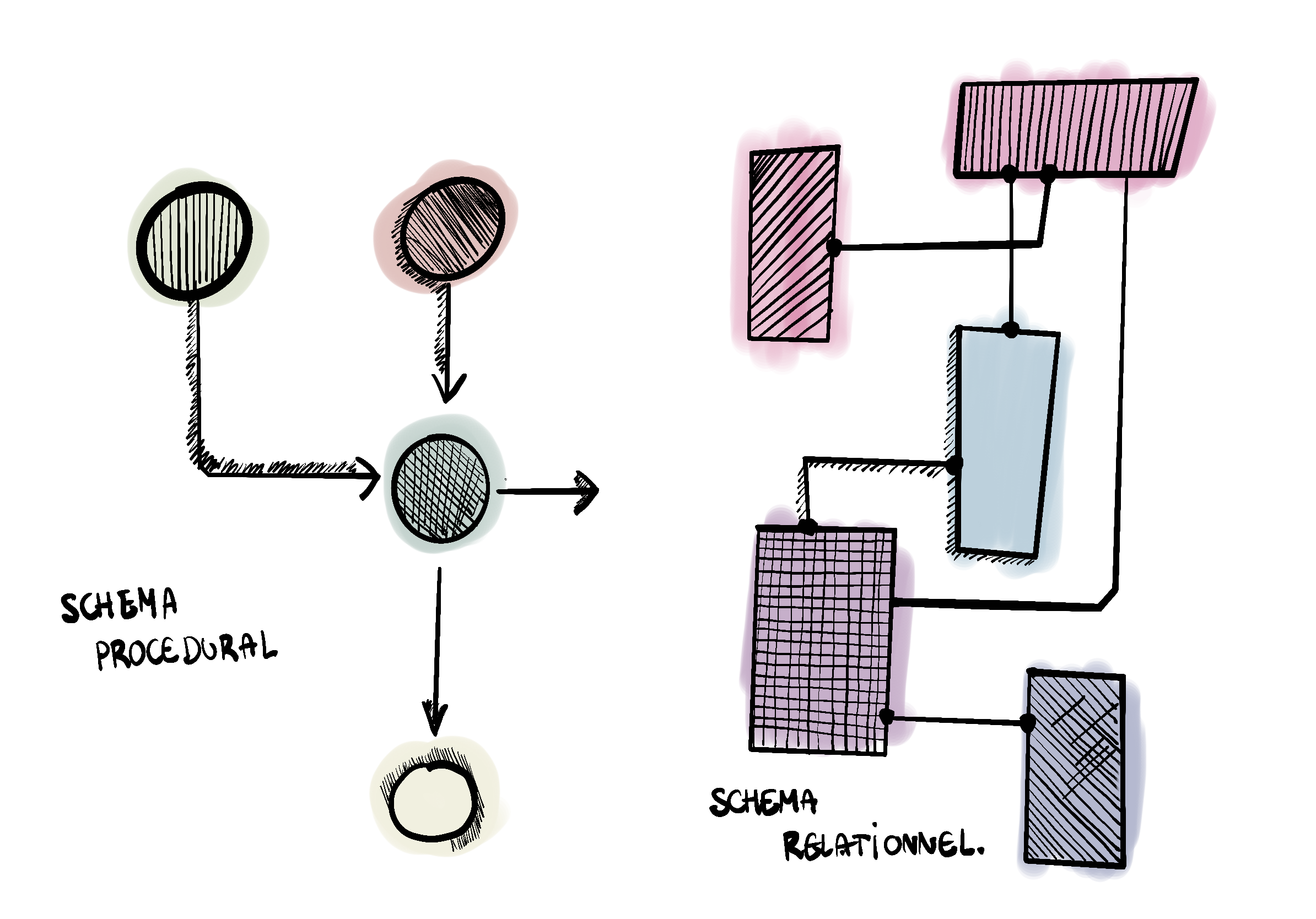

La notion de schéma pourrait être utilisée dans plusieurs cadres. Dans le cadre d'une réflexion, schématiser une pensée permet de mieux visualiser et/ou révéler une relation avec un effet questionné. Deux façons de comprendre ces types de schéma.

- Le premier traduirait un rapport de cause à effet, comme dans des processus, par exemple. On parlerait ici de schéma procédural, qui représente les différentes étapes permettant à un système de fonctionner.

- Le second traduirait simplement des relations entre des éléments. Dans ce cas, on parle de schéma relationnel. En conception de base de données, par exemple, dans un projet d'application, on parle rapidement de modèle relationnel : les liens qui existent entre les différentes tables du système.

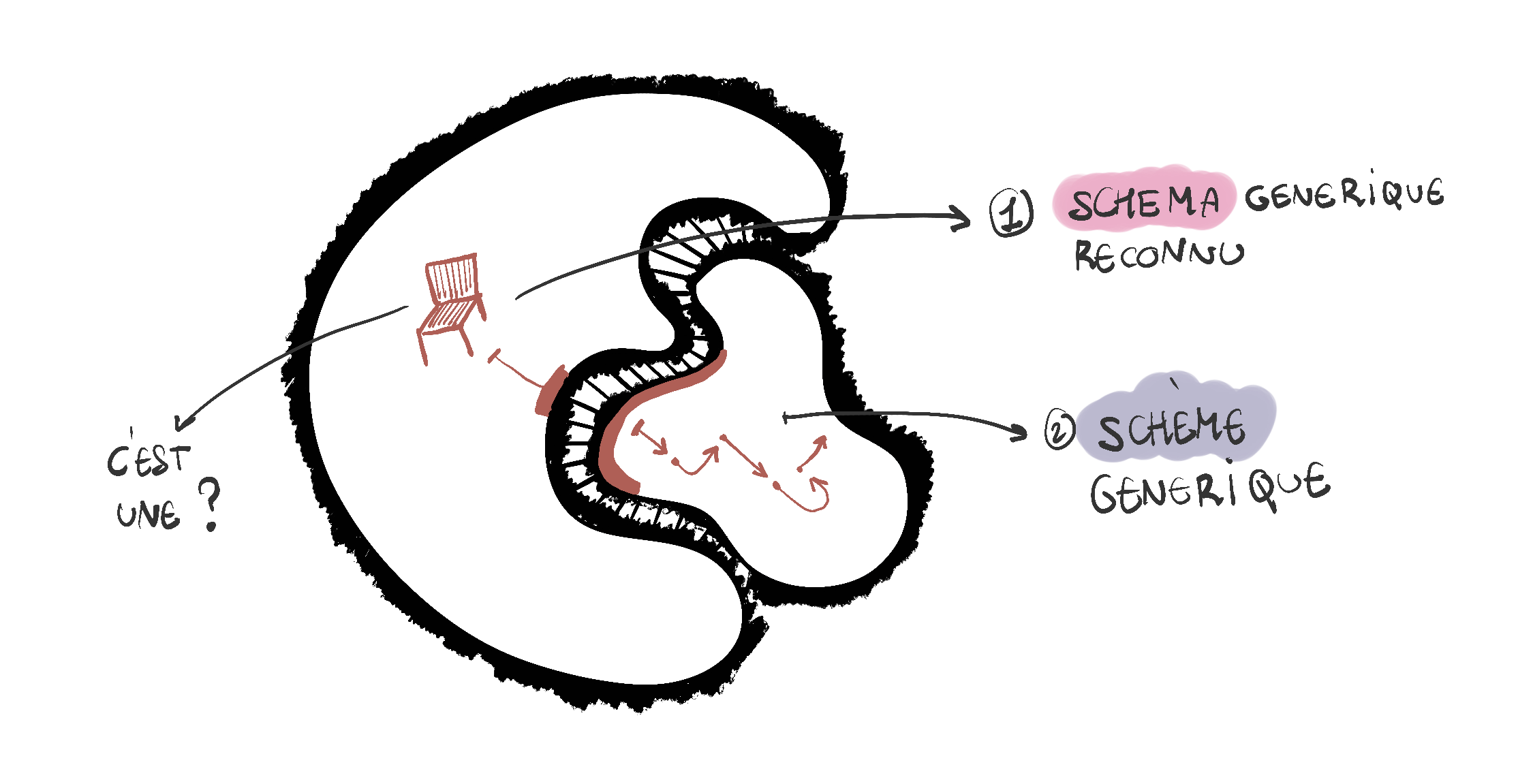

Dans le cadre du design ou de la conception d'un objet, physique ou numérique, le schéma aurait un rôle légèrement différent. Il permettrait d'identifier une idée générale. On pourrait parler de schéma générique. Pourquoi générique ? Car il appellerait des éléments simplifiés ou des combinaisons de ces éléments, qui rappellent des formes simple ou complexe souvent reconnues dans les environnements quotidiens ou experts. Le schéma générique appelle une sorte de simplification des environnements. Dans le numérique, on retrouve cette philosophie dans la notion de "wireframe", terme utilisé dans la conception de produits et services numériques. C'est une schématisation des zones fonctionnelles et des différentes actions possibles sur une "semblant" d'interface utilisateur. La grande particularité de ces schémas est qu'ils sont assez concrets pour être reconnus mais assez abstraits pour être généralisables. Le schéma d'une forme bien conçue pourrait être réutilisé et applicable entre plusieurs produits et services. Regardez une chaise, des toilettes, une tasse, etc. Au-delà des 1001 variations que la créativité humaine peut générer, un schéma permettrait de reconnaître l'essentiel pour une utilisation.

"Au-delà des 1001 variations..." C'est à ce moment où j'ai eu un moment dit "ampoulique ?!" Un schéma d'une chaise vous permet de comprendre ce que c'est et donc, par extension, ce que vous pouvez faire avec. Si on pousse le bouchon un peu trop loin (Maurice), et nous nous remettons dans notre sujet de cognition, on pourrait dire que le schéma serait en fait l'élément de base nécessaire pour comprendre une chose et interagir avec. Je parlais plus tôt de deux formes de schéma parmi trois, un schéma générique et un schéma procédural, mais il semblerait que nos schémas cognitifs comprennent en fait ces deux paramètres inséparables. La forme serait la porte de l'action. La reconnaissance d'un objet déclencherait automatiquement des actions potentielles envers cet objet. Expliqué autrement, la reconnaissance de schéma graphique permettrait le déclenchement de schémas procéduraux.

Si nous retransposons cette idée à notre univers cognitif, nous pourrions imaginer donc que nous stockerions des formes de schémas en mémoire. Un peu comme si nous avions une bibliothèque de plans en stock. Un ensemble de données extraites de stimuli environnementaux activeraient ces schémas auxquels seraient attachés des processus moteurs types et/ou réflexes. Peu importe la forme, la taille, la matière ou la couleur d’une tasse, cette capacité à reconnaître à travers ces schémas nous permettrait de savoir quoi faire avec. Vous n’avez pas besoin d’analyser chaque détail d'un truc sur une table pendant 10 minutes pour en déduire que c’est une tasse et savoir comment la prendre, cela se fait quasi instantanément. Si ce n’est pas le cas, alors vous avez un déficit cognitif dont le nom m’échappe au moment où j’écris ces lignes, mais ça existe ! Promis !

Des idées c’est bien beau, mais l’objectif ici n’est pas d’écrire une œuvre de fiction mais bien de mieux comprendre comment fonctionnerait la cognition. Je ne suis pas le premier à m’être posé ces questions et sûrement pas le dernier. En fouillant un peu autour de cette notion de schémas cognitifs, je suis tombé sur les concepts suivants. D’abord le dictionnaire, lui, nous parle de schémas comme des dessins, tracés figurant les éléments essentiels d'un objet, d'un ensemble complexe, d'un phénomène, d'un processus et destinés à faire comprendre sa conformation et/ou son fonctionnement. L'introduction du terme « schéma » est plus vieille que celle du dictionnaire, elle fut en fait faite par Kant dans sa critique de la raison pure en 1781. Il aborde les schémas comme des entités dont la fonction serait de lier les concepts et les catégories à l'image d'un objet. Pour lui, ils serviraient de formes « d’interfaces » entre le réel et l’imaginaire. Jean Piaget (1945) utilisa le terme de « schèmes » et les appliqua au développement humain : pour lui, des schèmes génériques de préhension peuvent s'appliquer à toutes les situations dans lesquelles un objet est saisi (cf : mon exemple de tasse plus haut). Le neurologue Henry Head (1920) et le psychologue Frédéric Bartlett (1932) parlèrent d'unités physiologiques dynamiques et adaptables. Toujours dans la partie motrice, Richard Schmidt (2003) émit l'hypothèse de schémas moteurs simples et adaptables à plusieurs utilisations. Au lieu d'utiliser deux programmes moteurs précis pour deux actions similaires comme attraper une assiette ou une fourchette, alors l'on utiliserait un seul et même programme à plusieurs variables qui s'adapterait en fonction des paramètres de la situation, comme la proximité, la taille, l'angle, etc. On peut voir une similitude entre cette hypothèse et celle avancée par Piaget. Pour rester en phase avec Piaget et Schmidt, on pourrait parler donc de schéma comme l’élément nécessaire à la reconnaissance d’objet, notre schéma générique, auxquels seraient attachés des schèmes, éléments nécessaires à l’interaction avec les objets reconnus par les schémas, nos schémas procéduraux.

Donc, ce qu'une théorie généralisée des schémas cognitifs induirait est que, là où l'environnement physique stockerait les données détaillées, le cerveau, lui, stockerait la façon dont ces informations seraient traitées.

Cette hypothèse n'est pas sans conséquences car elle ouvre la porte à une nouvelle hypothèse qui n'est pas des moindres. Si nous tirons le fil, cela voudrait dire que le cerveau ne garderait aucun détail en mémoire. Il stocke les plans des bâtiments mais jamais les bâtiments eux-mêmes. Nous ne stockerions donc que des informations partielles sur le monde. Cela voudrait dire que nous serions toujours dépendants des environnements pour (re)construire une information complète. S'instaurerait alors une dépendance entre le monde sensoriel extérieur et le système nerveux. Le second ne pourrait pas fonctionner sans le premier.

Bon ben voilà ! Cela nous fait une belle jambe, mais malheureusement, cet épisode n'a pas totalement répondu à la question de base. Nous avons émis l'idée que pour traiter autant d'informations en quasi temps réel, en stockant des versions schématisées et mutualisées du monde, le cerveau n'aurait besoin que de traiter qu'une petite quantité d'informations pour activer une série d'actions. Ces schémas seraient stockés en mémoire et permettraient de rapidement reconnaître des formes sensorielles réparties dans nos environnements matériels et ainsi leur donner un usage potentiel. Par ce moyen, on éviterait de traiter l'infinité de données du monde sensoriel pour agir plus rapidement. Mais tout cela soulève une hypothèse encore plus dérangeante... (Notez les petits points qui sont censés faire monter une forme de suspense)... si le cerveau est conçu pour reconnaître et si pour reconnaître, il faut connaître, alors toutes nouvelles connaissances ne seraient en fait que des reconnaissances. Et donc, au final, comme dirait l'autre, "est-ce qu'on peut vraiment être confronté à une vraie nouvelle connaissance ?"

Pour cela, il nous faudrait fouiller ce concept de reconnaissance et y mettre les bonnes formes...

On en parle la prochaine fois ?

Gd.